Это всё чёрная кошка виновата, а не бэкапы там какие-то несделанные

Почему так происходит? Предлагаю рассмотреть 9 возможных причин.

Публикации, рассказывающие о хранилищах данных

Рассказываем, как использовать методы стеганографии и шифрования в децентрализованных сервисах на IPFS. Исключаем риски, связанные с централизованным хранением логинов и паролей. Используем метод LSB, «наименьший значащий бит». Внутри статьи — примеры кода на C# и алгоритме AES для шифрования и расшифровки.

Привет! Меня зовут Михаил Кажемский, я Lead DevOps в IT‑интеграторе Hilbert Team. В последнее время к нам часто обращаются заказчики, которым нужна помощь с организацией хранения долгосрочных метрик в российских облаках. Так как для многих эта задача сейчас актуальная, в данной статье мы с моим коллегой Денисом Бабичевым решили рассказать, как мы используем мощные возможности ClickHouse для эффективного долгосрочного хранения метрик Prometheus. В статье вы найдете рекомендации по использованию инструмента и описание альтернативных решений, таких как Thanos, Grafana Mimir и Victoria Metrics.

Уже много написано о его развертывании и о функционале, поэтому мне бы хотелось поговорить об опыте внедрения Superset с организационной точки зрения, а также я постараюсь описать техническое окружение и важные отличия от Power BI. Отдельно остановлюсь на системе прав доступа, т.к. в нашей компании этот вопрос важен.

Неизбежность отключения корпоративных пользователей от «облачных» продуктов Microsoft (и не только) стала очевидной последние два года. В текущий известный список продуктов, которые точно будут отключены, входят корпоративный мессенджер Teams, Office 365, облачное хранилище OneDrive и облако Azure.

Что делать? Можно перейти на отечественные облачные платформы и сервисы. Можно развернуть аналоги «уходящих» решений на собственной инфраструктуре. А можно арендовать выделенные сервера и создать инфраструктуру на них, или арендовать виртуальные сервера у хостинг-провайдеров с решениями быстрого развертывания. И об этом мы хотим поговорить с вами на примере Microsoft Teams и OneDrive.

Привет! Меня зовут Никита Гуцалов, я инженер в компании YADRO и занимаюсь разработкой ПО для системы хранения данных TATLIN.UNIFIED. Вообще с системами хранения данных (СХД) я работаю уже много лет и люблю эту тему, поскольку она постоянно бросает новые вызовы, заставляя решать довольно сложные и нестандартные проблемы, что очень увлекательно само по себе, а удачные решения приносят огромное удовлетворение.

В статье я попытаюсь погрузить читателя в проблемы, с которыми нам, инженерам YADRO, приходится сталкиваться при отладке программного обеспечения СХД. Также покажу особенности работы с такими системами. Расскажу, какие инструменты, а иногда и решения, которые мы пишем сами, приходится для этого применять. А еще постараюсь сформулировать условия, которые необходимы для нахождения причин возникновения ошибок обработки данных в системе.

Текст про особенности поиска багов был бы пустым без конкретных примеров, поэтому под катом вас ждет разбор случая, который как-то произошел в нашей лаборатории при тестировании производительности СХД.

Меня зовут Михаил Гелемеев, я лидер команды сопровождения Platform V Pangolin в СберТехе.

Platform V Pangolin — реляционная система управления базами данных. Она основана на свободно распространяемой версии PostgreSQL и содержит ряд доработок, обеспечивающих соответствие повышенным требованиям к безопасности данных, доступности, надежности, а также удобству эксплуатации. Наш продукт помогает получить функциональные возможности реляционной СУБД, включая построение кластеров высокой доступности, резервирование данных, снятие и восстановление резервных копий.

В январе мы выпустили новую версию — Platform V Pangolin 6.1. В ней появились обновления для работы с большим объёмом данных. Если вкратце — работать с секциями стало проще и быстрее: дешевле доступ к данным в секционированных таблицах, и для них можно гибко создавать уникальные глобальные индексы. Теперь можно предотвратить высокое потребление CPU и RAM пользовательской сессией, это улучшает доступность сервиса. Мы также добавили инструмент диагностики текущей активности для детального понимания процессов сессии, так работа СУБД становится более прозрачной.

В статье подробнее расскажу о каждой из доработок. Их можно условно разделить на две части: для пользователей и для администраторов/инфраструктуры.

В эпоху данных и активной цифровизации вопросы эффективного управления данными становятся все более актуальными. От того, насколько эффективно компания управляет своими данными, зависит эффективность принятия управленческих решений, что влияет на выручку компании и чистую прибыль.

Вопросы управления данными включают задачи эффективного хранения и обработки данных (КХД, озера данных, ETL & ELT) в облаках и On-Premise, настройки интеграционных потоков (транспорт) для анализа в режиме реального времени и не только, вопросы предоставления данных во внешние системы и BI, процессы качества данных и каталогизации, безопасность данных, решения на базе расширенной аналитики и ИИ.

Александр Сулейкин, кандидат технических наук, генеральный директор и архитектор Big Data систем компании “ДЮК Технологии” дает прогноз на предстоящий год: какие технологии управления данными будут развиваться, с какими проблемами сталкивается бизнес и каких технологий не хватает для полноценного импортозамещения.

Кажется, что эпоха жестких дисков давно ушла. SSD-накопители если не вытеснили HDD с рынка комплектующих для консьюмерских ПК, то сильно пошатнули их позиции. Иначе и быть не могло, когда имеешь дело с очевидно превосходящим решением, которое развивается семимильными шагами. Несмотря на это, жесткие диски все еще продаются и даже пользуются определенной популярностью. Эту статью мы подготовили для тех, кто сомневается и не уверен в рациональности приобретения (или, наоборот, не-приобретения) HDD в 2024 году. Никакого rocket science под катом -- только факты и их анализ, а также сегодня мы расскажем про пять сфер, в которых HDD остаются лучшее SSD.

Этот материал уже без шуточек. Технический обзор и оценка принятых решений. На самом деле шуточки есть, но я не смог окончательно от них избавиться. Видимо, без них нет меня.

Привет, Хабр!

Сегодня я хочу поговорить о GDPR – регуляции, которая изменила понимание приватности данных в Европе и за ее пределами. На первый взгляд, GDPR может показаться очередной бюрократической головной болью, но на самом деле это очень большой шаг в сторону уважения и защиты личной информаций.

GDPR выступает не как какой-то набор ограничений, а как стимул для повышения качества работы с данными.

Санкции за несоблюдение GDPR могут быть очень большими, в некоторых случаях доходя до 10 миллионов евро или 2% от общего мирового годового оборота за предыдущий финансовый год, а в других случаях — до 20 миллионов евро или до 4% от общего мирового годового оборота. Размер штрафа оценивается индивидуально и зависит от множества факторов, как серьезность нарушения, степень причиненного ущерба, наличие умысла, и многое другое.

В этой статье мы рассмотрим несколько основных принципов GDPR.

Последние 10 лет о данных говорят, что это новое электричество, новая нефть, из которых можно извлекать выгоду для компании. Но не все умеют это делать. Если данные просто лежат в старой Oracle Exadata или внутри 1С, толку от них немного. Если же вы научитесь создавать новые аналитические связи для дальнейшего анализа бизнес-процессов или предсказывать тренды на основе исторических данных — это уже другая история.

Привет, Хабр! Меня зовут Максим Еремин, руководитель направления развития продуктов beeline cloud, и сегодня я затрону тему работы с данными: почему ими нужно уметь управлять и с какими трудностями вы можете столкнуться.

А 19 марта в 11:00 мск я проведу вебинар о том, как эффективно хранить и обрабатывать большие объемы данных, когда в компании множество разрозненных корпоративных систем. Возникли вопросы? Накидывайте в комментариях — обсудим.

Привет, Хабр! Миграция баз данных из одной СУБД в другую представляет собой особо сложную задачу, требующую тщательного планирования, подготовки и исполнения. В 2023 году в Сбербанке завершился масштабный проект по миграции крупного аналитического хранилища данных с платформы Teradata на GreenPlum. Особое внимание уделялось таким направлениям, как:

Повышенная трудоёмкость ручного переписывания SQL‑скриптов из‑за разницы в диалекте и специфических встроенных функций Teradata.

• Перенос архива данных из Teradata, объемом более 400 Тб.

• Кросс‑платформенная проверка качества данных в ходе и после завершения миграции.

Этой статьёй мы открываем небольшую серию, посвящённую технологическим решениям вышеупомянутых сложностей. И начнём с рассмотрения сервиса миграции кода из Teradata в GreenPlum, который автоматизирует и упрощает конвертацию сложных запросов.

Сегодня бизнес хочет принимать решения, основываясь на данных, а не на ощущениях, тем более что сейчас для этого есть все возможности. Предприятия накопили терабайты и эксабайты данных, их количество растет в геометрической прогрессии каждый день.

Как повлиял ковид на ценообразование загородной недвижимости? Какой регион выбрать для новой мебельной фабрики? Вложиться в жилой комплекс эконом или бизнес-класса? Какие факторы влияют на продление ДМС? Как должно работать индивидуальное автострахование?

В наши дни ты должен быть data-driven или проиграешь.

Сырые данные предприятия проходят большой путь, чтобы превратиться в управленческие решения. Этот путь включает такие шаги как:

Привет, Хабр.

В одном из наших недавних постов мы немного затронули тему автоматизации, которую мы активно продвигаем в наших продуктах. По различным каналам мы получили много положительных откликов и дополнительных вопросов о том, как можно использовать наши API для различных интеграций.

В рейтинге наиболее популярных «хотелок» – интеграция системы хранения данных с внешними отечественными или opensource продуктами: системы мониторинга, системы управления и планирования ёмкостей или сложные автоматизированные метрокластеры с классическим набором серверов приложений, СУБД и систем виртуализации.

Решив, что краткого упоминания о REST API в системах хранения данных АЭРОДИСК явно недостаточно, в этой статье мы расскажем о том, как автоматизировать создание классических репликации, конфигурации метрокластера и управлять переключением сайтов с использованием REST API и Python. А послушать про это можно будет на вебинаре «ОколоИТ», который пройдёт 12 марта в 15:00 – регистрируйтесь по ссылке.

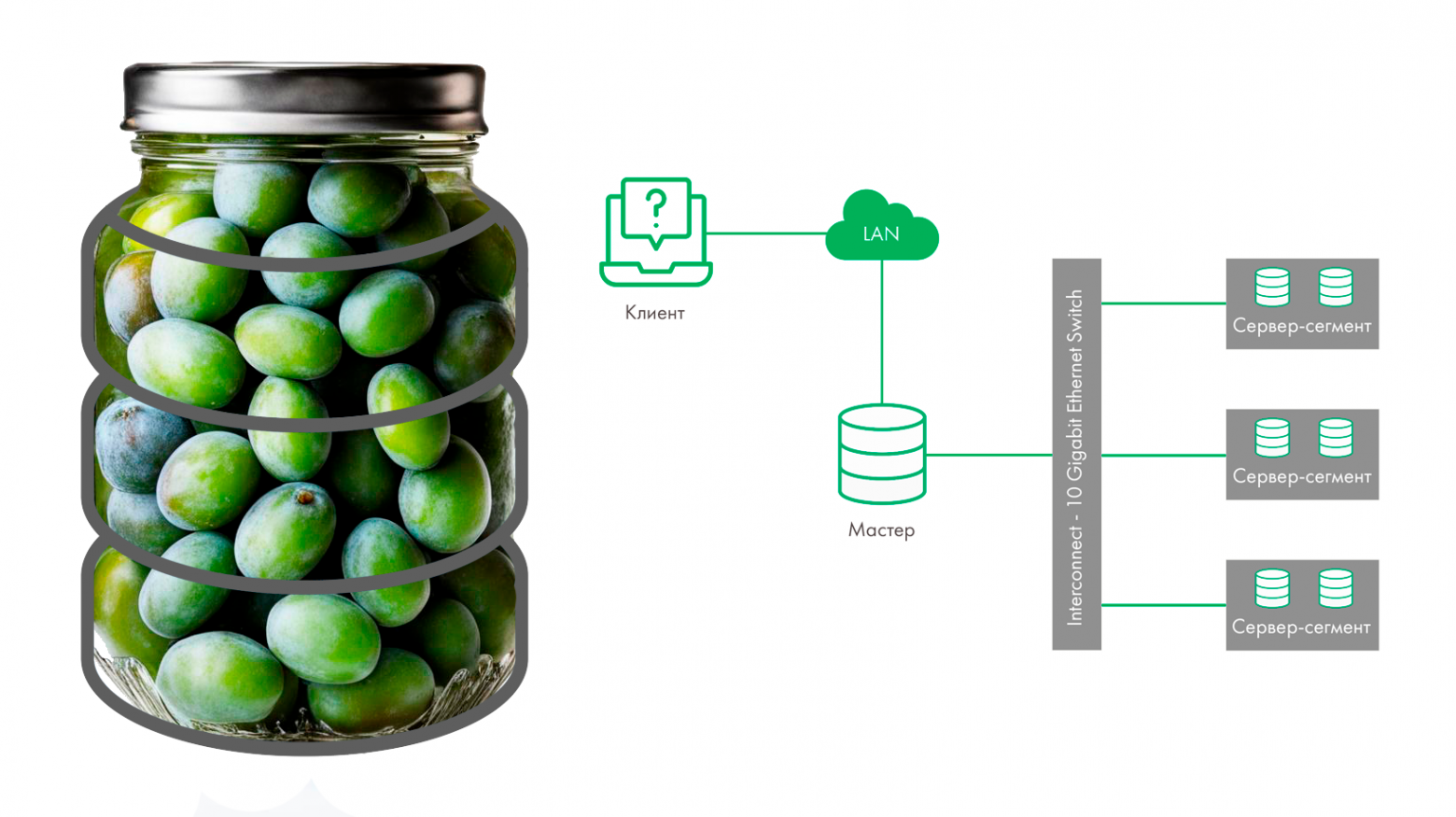

Для запуска и эксплуатации высоконагруженных ИТ-решений с петабайтами данных в активе, нужно проработанное решение, позволяющее гибко управлять ресурсами. Одним из критичных аспектов этого решения, является разделение Compute & Storage — разделение ресурсов инфраструктуры под вычисление и хранение соответственно. Если не реализовать такое разделение в крупном проекте, инфраструктура рискует превратиться в «чемодан без ручки» — эффективность использования ресурсов будет низкой, а сложность управления ресурсами и средами будет высока. На примере команды SberData и их корпоративной аналитической платформы я расскажу, когда требуется разделение Compute & Storage и как это реализовать максимально нативно.

Статья подготовлена по мотивам доклада на VK Data Meetup «Как разделить Compute & Storage в Hadoop и не утонуть в лавине миграций».

Ошибки в построении DWH возникают не только в результате того, что первоначально не были учтены возможные изменения в бизнес-процессах, потребностях и целях компании, но и из-за некорректного выбора стека технологий и СУБД.

Порядок хранения данных выбирается в соответствии с разными сценариями работы - запросами, разным объемом данных, количеством транзакций, необходимостью обновлений данных.

В статье читайте о СУБД Greenplum и о том, в каких случаях строить хранилища на ее основе.

Когда-то файлы хранили на дискетах, потом на дисках, потом на флэшках. Закончилось всё облаками. Тогда встал ряд различных вопросов по надёжности и приватности. С одной стороны можно просто доверить файлы гуглу или яндексу, но тогда о приватности можно забыть. C другой стороны можно завести собственное облачное хранилище, будь то дорогое железное решение от Synology, или оперсорсное на арендованной vps на nextcloud, но тут требуется вовлечение, что бы облако оставалось в рабочем состоянии (следить за апдейтами, своевременно обновлять оборудование, поддерживать резервное железо). Вместе с развитием блокчейна и развитием децентрализованных технологий web 3.0, появились и облачные хранилища, обещающие приватность, доступность и низкую цену. Предлагаю к рассмотрению 2 проекта, которые появились более 10 лет назад, и до сих пор существуют - Filecoin и Storj.

Перенос файлов от одного облачного провайдера S3 к другому должен был обойтись нам примерно в 133 000 рублей. Вместо этого, мы заплатили за него около 29 000 рублей. Как можно в 5 раз удешевить этот процесс – рассказываем в статье.

Ваш аккаунт